„Tesla Optimus Humanoid“ robotas eina per gamyklą su žmonėmis. Nuspėjamam robotų elgesiui reikalinga prioritetu pagrįsta kontrolė ir teisinė sistema. Kreditas: „Tesla“

Robotai tampa protingesni ir labiau nuspėjami. „Tesla Optimus“ pakelia dėžes gamykloje, 01 pav. Pilna kavos, o Waymo nešiojasi keleiviams be vairuotojo. Šios technologijos nebėra demonstracijos; Jie vis labiau patenka į realų pasaulį.

Tačiau dėl to kyla pagrindinis klausimas: kaip mes galime užtikrinti, kad robotas priims teisingą sprendimą sudėtingoje situacijoje? Kas nutiks, jei ji gautų dvi prieštaringas komandas iš skirtingų žmonių tuo pačiu metu? Ir kaip mes galime būti tikri, kad ji nepažeis pagrindinių saugos taisyklių – net jo savininko prašymu?

Kodėl įprastos sistemos žlunga? Dauguma šiuolaikinių robotų veikia iš anksto nustatytuose scenarijuose – komandų rinkinys ir reakcijų rinkinys. Inžinerijos požiūriu tai yra elgesio medžiai, baigtinės būklės mašinos arba kartais mokymasis mašinų. Šie požiūriai gerai veikia kontroliuojamomis sąlygomis, tačiau komandos realiame pasaulyje gali prieštarauti vienas kitam.

Be to, aplinka gali pasikeisti greičiau, nei gali prisitaikyti robotas, ir nėra aiškaus „prioritetinio žemėlapio“, kuris svarbu čia ir dabar. Dėl to sistema gali dvejoti arba pasirinkti neteisingą scenarijų. Autonominio automobilio ar humanoidinio roboto atveju toks nuspėjamas dvejonės nebėra tik klaida – tai yra saugos rizika.

Nuo reaktyvumo iki prioritetine kontrolės

Šiandien dauguma autonominių sistemų yra reaktyvios – jos reaguoja į išorinius įvykius ir komandas, tarsi jos būtų vienodai svarbios. Robotas gauna signalą, iš atminties atgauna atitinkamą scenarijų ir jį vykdo, neatsižvelgdamas į tai, kaip jis tinka didesniam tikslui.

Dėl to nuspėjamos komandos ir įvykiai konkuruoja tuo pačiu prioriteto lygiu. Ilgalaikes užduotis lengvai nutraukia tiesioginiai dirgikliai, o sudėtingoje aplinkoje robotas gali plaukti, bandydamas patenkinti kiekvieną įvesties signalą.

Be tokių įprastų operacijų problemų, visada kyla techninių nesėkmių rizika. Pavyzdžiui, per pirmąjį pasaulio humanoidinių robotų žaidimus Pekine šį mėnesį H1 robotas iš „Unitree“ nukrypo nuo optimalaus kelio ir numušė žmogaus dalyvį į žemę.

Panašus atvejis įvyko anksčiau Kinijoje: techninės priežiūros darbų metu robotas staiga ėmė chaotiškai glostyti ginklus, smogiančius inžinierius, kol jis nebuvo atsiribojęs nuo valdžios.

https://www.youtube.com/watch?v=rb8plfmbl2s

Abu incidentai aiškiai parodo, kad šiuolaikinės autonominės sistemos dažnai reaguoja neišanalizuodamos pasekmių. Nesant kontekstinio prioritetų nustatymo, net nereikšminga techninė gedimas gali peraugti į pavojingą situaciją.

Architektūra, neturinti integruotos logikos saugumo prioritetų ir sąveikos su subjektais, tokių kaip žmonės, robotai ir objektai, valdymas, nesuteikia jokios apsaugos nuo tokių scenarijų.

Mano komanda suprojektavo architektūrą, kad elgesys iš „stimulo-atsako“ režimo pavertė sąmoningu pasirinkimu. Kiekvienas įvykis pirmiausia praeina per misijos ir temų filtrus, vertinamas atsižvelgiant į aplinkos ir pasekmes, o tik tada pradedamas vykdyti. Tai leidžia robotams veikti nuspėjamai, nuosekliai ir saugiai – net ir dinaminėmis ir nenuspėjamomis sąlygomis.

Dvi hierarchijos: prioritetai veikiant

Mes sukūrėme valdymo architektūrą, kuri tiesiogiai kreipiasi į nuspėjamą robotiką ir reaktyvumą. Jo esmė yra dvi tarpusavyje susijusios hierarchijos.

1. Misijos hierarchija – Struktūrizuota tikslo prioritetų sistema:

- Strateginės misijos – esminės ir nepakeičiamos: „Nepakenkite žmogaus“, „padėk žmonėms“, „paklusk taisyklėms“.

- Vartotojo misijos – savininko ar operatoriaus nustatytos užduotys

- Dabartinės misijos – antrinės užduotys, kurias galima nutraukti svarbesniems

2. Sąveikos subjektų hierarchija – Komandų ir sąveikų prioritetų nustatymas atsižvelgiant į šaltinį:

- Aukščiausias prioritetas – savininkas, administratorius, operatorius

- Antrinis – įgalioti vartotojai, tokie kaip šeimos nariai, darbuotojai ar paskirtos robotai

- Išorinės partijos – kiti žmonės, gyvūnai ar robotai, kurie svarstomi atliekant situacijos analizę, tačiau negali kontroliuoti sistemos

Kaip praktiškai veikia nuspėjama kontrolė

1 atvejis. Humanoidinis robotas – Robotas nešioja dalis surinkimo linijoje. Vaikas iš lankomosios kelionių grupės prašo perduoti sunkų įrankį. Užklausa pateikiama iš išorės partijos. Misija gali būti nesaugi, o ne dabartinių užduočių dalis.

- Sprendimas: nekreipkite dėmesio į komandą ir tęskite darbą.

- Rezultatas: tiek vaikas, tiek gamybos procesas išlieka saugus.

2 atvejis. Autonominis automobilis – Keleivis prašo pagreitinti, kad išvengtų vėlavimo. Jutikliai aptinka ledą kelyje. Užklausa pateikiama iš aukšto prioriteto dalyko. Tačiau strateginė misija „užtikrinti saugumą“ nusveria patogumą.

- Sprendimas: automobilis nepadidina greičio ir perskaičiuoja maršrutą.

- Rezultatas: Sauga turi absoliučią prioritetą, net jei vartotojui nepatogu.

Trys nuspėjamų sprendimų priėmimo filtrai

Kiekviena komanda praeina per tris patikrinimo lygius:

- Kontekstas – Aplinka, robotų būsena, įvykių istorija

- Kritiškumas – koks pavojingas veiksmas būtų

- Pasekmės – Kas pasikeis, jei komanda bus vykdoma ar atsisakoma

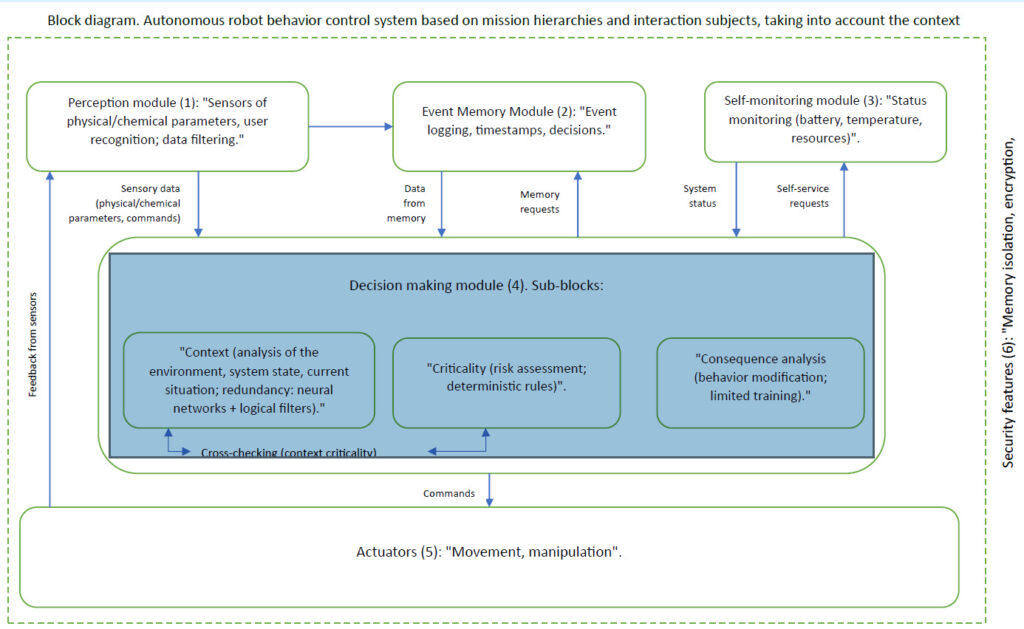

Jei koks nors filtras padidina aliarmą, sprendimas yra persvarstytas. Techniškai architektūra įgyvendinama pagal žemiau esančią bloko diagramą:

Valdymo architektūra, skirta spręsti robotų reaktyvumą. (Norėdami padidinti

Teisinis aspektas: neutralus autonominis statusas

Mes peržengėme techninę architektūrą ir siūlėme naują teisinį modelį. Norint tiksliai suprasti, jis turi būti aprašytas oficialia teisine kalba. AI ir AI varomų autonominių sistemų „neutralus autonominis statusas“ yra teisiškai pripažinta kategorija, kurioje tokios sistemos nėra laikomos nei tradicinės teisinės atsakomybės objektais, pavyzdžiui, įrankiais, nei kaip teisės subjektais, tokiais kaip gamtos ar teisės asmenys.

Šis statusas pristato naują teisinę kategoriją, kuri pašalina AI reguliavimo netikrumą ir išvengia ekstremalių požiūrių į teisinį pobūdį apibrėžti. Šiuolaikinės teisinės sistemos veikia su dviem pagrindinėmis kategorijomis:

- Teisės subjektai – Natūralūs ir teisiniai asmenys, turintys teises ir įsipareigojimus

- Teisės objektai – Dalykai, įrankiai, nuosavybė ir nematerialusis turtas, kurį kontroliuoja tiriamieji

PG ir autonominės sistemos neatitinka nė vienos kategorijos. Jei laikomi objektais, visa atsakomybė visiškai priklauso nuo kūrėjų ir savininkų, todėl juos sukelia per didelė teisinė rizika. Jei jie laikomi subjektais, jie susiduria su esmine problema: teisinių galimybių, ketinimų ir gebėjimo prisiimti įsipareigojimus stoka.

Taigi, norint nustatyti subalansuotą atsakomybės ir atsakomybės sistemą-neutraliautonominiam statusui, būtina trečioji kategorija.

Teisiniai neutralaus autonominio statuso mechanizmai

Pagrindinis principas yra tas, kad kiekviena AI arba autonominė sistema turi būti priskirtos aiškiai apibrėžtos misijos, kurios nustato jos tikslą, autonomijos apimtį ir teisinę atsakomybės pagrindą. Misijos yra teisinė riba, ribojanti AI veiksmus ir nustato atsakomybės paskirstymą.

Teismai ir reguliavimo institucijos turėtų įvertinti autonominių sistemų elgesį, remdamiesi jų paskirtomis misijomis, užtikrindami struktūrizuotą atskaitomybę. Kūrėjai ir savininkai yra atsakingi tik paskirtose misijose. Jei sistema veikia už jų ribų, atsakomybę lemia konkrečios nukrypimo aplinkybės.

Vartotojai, sąmoningai išnaudojantys sistemas, viršijančias jų nustatytas užduotis, gali susidurti su didesne atsakomybe.

Nenumatyto elgesio atvejais, kai veiksmai išlieka paskirtose misijose, taikomas sušvelnintos atsakomybės mechanizmas. Kūrėjai ir savininkai yra apsaugoti nuo visiškos atsakomybės, jei sistema veikia pagal apibrėžtus parametrus ir misijas. Vartotojams naudinga sušvelninta atsakomybė, jei jie sąžiningai panaudojo sistemą ir neprisidėjo prie anomalijos.

Hipotetinis pavyzdys

Autonominė transporto priemonė patenka į pėsčiąjį, kuris staiga nubėga į greitkelį už perėjos. Sistemos misijos: „Užtikrinkite saugų keleivių pristatymą pagal eismo įstatymus“ ir „išvengkite susidūrimų sistemos techninėmis galimybėmis“, nustatant atstumą, kurio pakanka saugiam stabdymui.

Sužeista šalis reikalauja 10 milijonų dolerių iš savarankiškai važiuojančio automobilių gamintojo.

1 scenarijus: Misijų laikymasis. Pėstiesiems pasirodė 11 m į priekį (0,5 sekundės, esant 80 km/h arba 50 mylių per valandą) – saugus stabdymo atstumas – maždaug 40 m (131,2 pėdų). Automobilis pradėjo stabdyti, bet negalėjo laiku sustoti. Teismas nusprendžia, kad automobilių gamintojas laikėsi misijos laikymosi, todėl sumažino atsakomybę iki 500 000 USD, o dalinė kaltė buvo paskirta pėstiesiems. Santaupos: 9,5 mln. USD.

2 scenarijus: misijos kalibravimo klaida. Naktį dėl fotoaparato kalibravimo klaidos automobilis neteisingai klasifikavo pėsčiąjį kaip statinį objektą, atidėdamas stabdymą 0,3 sekundės. Šį kartą automobilių gamintojas yra atsakingas už klaidingą konfigūraciją – 5 mln. USD, bet ne 10 milijonų dolerių, dėka statuso apibrėžimo.

3 scenarijus: vartotojo misijos pažeidimas. Savininkas nukreipė automobilį į draudžiamą statybos zoną, nepaisydamas įspėjimų. Savininkui tenka 10 milijonų dolerių atsakomybė. Autonominių transporto priemonių įmonė yra ekranuota, nes buvo pažeistos misijos.

Šis pavyzdys parodo, kaip atsakomybė už neutralią ir autonominę būsenos struktūrą, apsaugoti kūrėjus ir vartotojus, atsižvelgiant į aplinkybes.

Neutralus autonominis statusas siūlo verslo, reguliavimo išmokas

Įdiegus neutralią autonominį statusą, sumažėja teisinė rizika. Kūrėjai yra apsaugoti nuo nepateisinamų ieškinių, susijusių su sistemos elgesiu, ir vartotojai gali pasikliauti nuspėjamomis atsakomybės sistemomis.

Reguliavimo institucijos įgytų struktūrizuotą teisinį pagrindą, mažindamos nutarimų nenuoseklumą. Teisiniai ginčai, susiję su AI, pereis nuo savavališko precedento prie vieningos sistemos. Gali atsirasti nauja AI autonomijos lygio ir misijos sudėtingumo klasifikavimo sistema.

Bendrovės, priimančios neutralų statusą anksti, gali sumažinti teisinę riziką ir efektyviau valdyti AI sistemas. Kūrėjai įgytų didesnę laisvę išbandyti ir diegti sistemas legaliai pripažintuose parametruose. Verslas galėtų save pozicionuoti kaip etikos lyderius, didinti reputaciją ir konkurencingumą.

Be to, vyriausybės gautų subalansuotą reguliavimo priemonę, išlaikydamos naujoves, saugančias visuomenę.

https://www.youtube.com/watch?v=lrrtw16Gale

Kodėl svarbu nuspėjamas robotų elgesys

Mes esame ant masinio humanoidinių robotų ir autonominių transporto priemonių dislokavimo slenksčio. Jei šiandien nepavyks nustatyti tvirtų techninių ir teisinių pagrindų, rytoj rizika gali būti didesnė už naudą – ir visuomenės pasitikėjimas robotika gali būti pakenkta.

Misijos ir temų hierarchijose sukurta architektūra, kartu su neutralia autonomine būkle, yra pagrindas, ant kurio galima saugiai sukurti kitą nuspėjamos robotikos etapą.

Ši architektūra jau buvo aprašyta patentų programoje. Esame pasirengę bandomojo bendradarbiavimui su humanoidinių robotų, autonominių transporto priemonių ir kitų autonominių sistemų gamintojais.

Redaktoriaus pastaba: „Robobusiness 2025“, kuris vyks spalio 15 ir 16 dienomis Santa Klaroje, Kalifornijoje, bus rodomi sesijos takeliai apie fizinę AI, įgalinančios technologijas, humanoidus, lauko robotus, dizainą ir plėtrą bei geriausią verslo praktiką. Registracija dabar atidaryta.

Apie autorių

Zhengis Tileubay yra nepriklausomas tyrėjas iš Kazachstano Respublikos, susijusios su klausimais, susijusiais su žmonių, autonominių sistemų ir dirbtinio intelekto sąveika. Jo darbas sutelktas į saugios robotų elgesio kontrolės architektūros kūrimą ir naujų teisinių požiūrių į autonominių technologijų statusą.

Tyrimo metu Tileubay sukūrė elgesio kontrolės architektūrą, pagrįstą misijų ir sąveikaujančių dalykų hierarchija. Jis taip pat pasiūlė „neutralaus autonominio statuso“ sąvoką.

„Tileubay“ pateikė šios architektūros patentinę paraišką pavadinimu „Autonominė robotų elgesio kontrolės sistema, pagrįsta misijų ir sąveikos dalykų hierarchijomis, su konteksto supratimu“ su Kazachstano Respublikos patentų tarnyba.